Ai2 OLMoE官网 Ai2 OLMoE网页版入口

2026-03-19 11:42:00来源:未知编辑:ZaxF

Ai2 OLMoE是艾伦人工智能研究院(AI2)推出的完全开源混合专家(MoE)大语言模型,以稀疏激活架构实现“7B总参、1B激活”的高效推理,完整开放权重、代码、训练数据与日志。

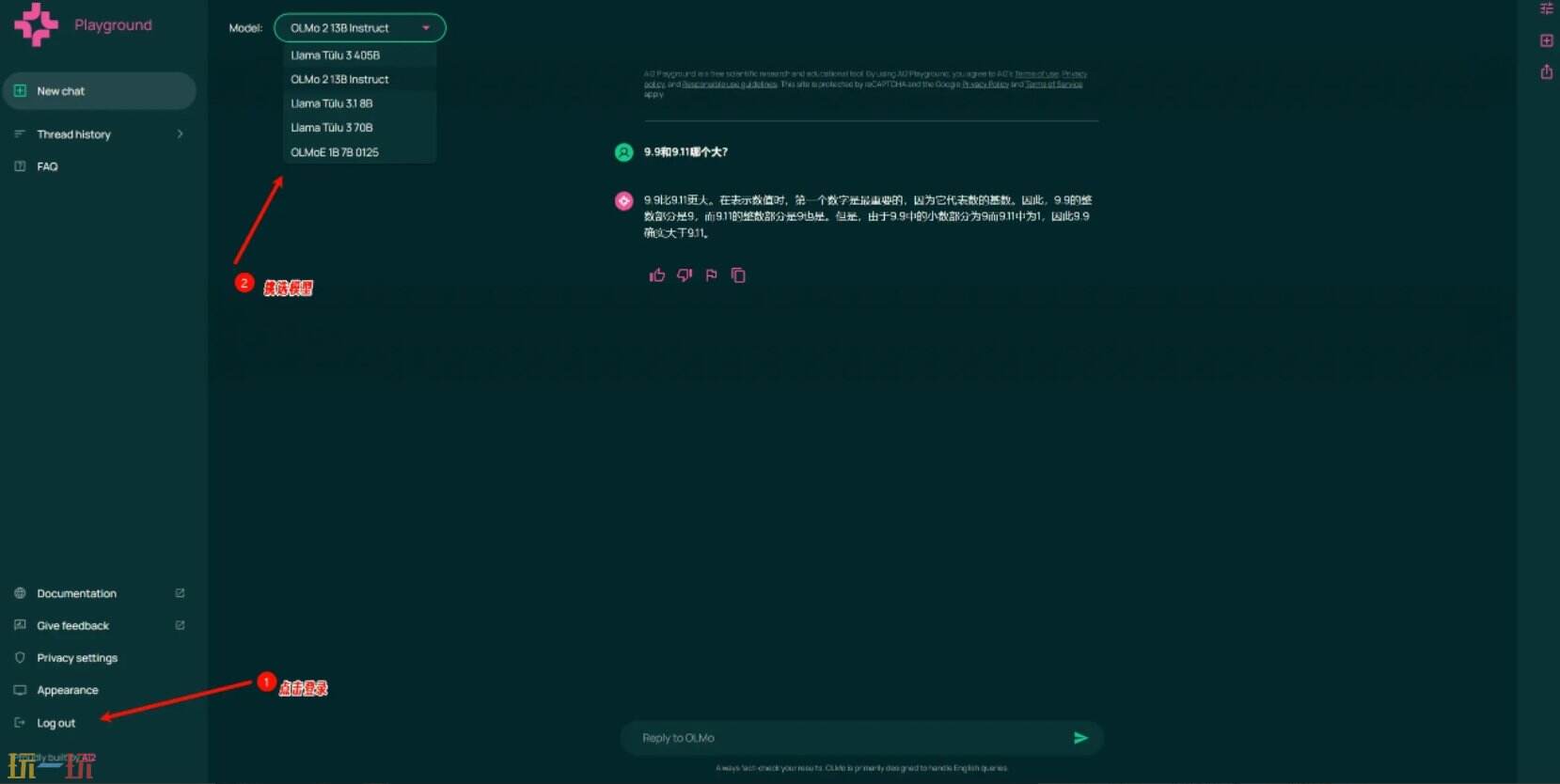

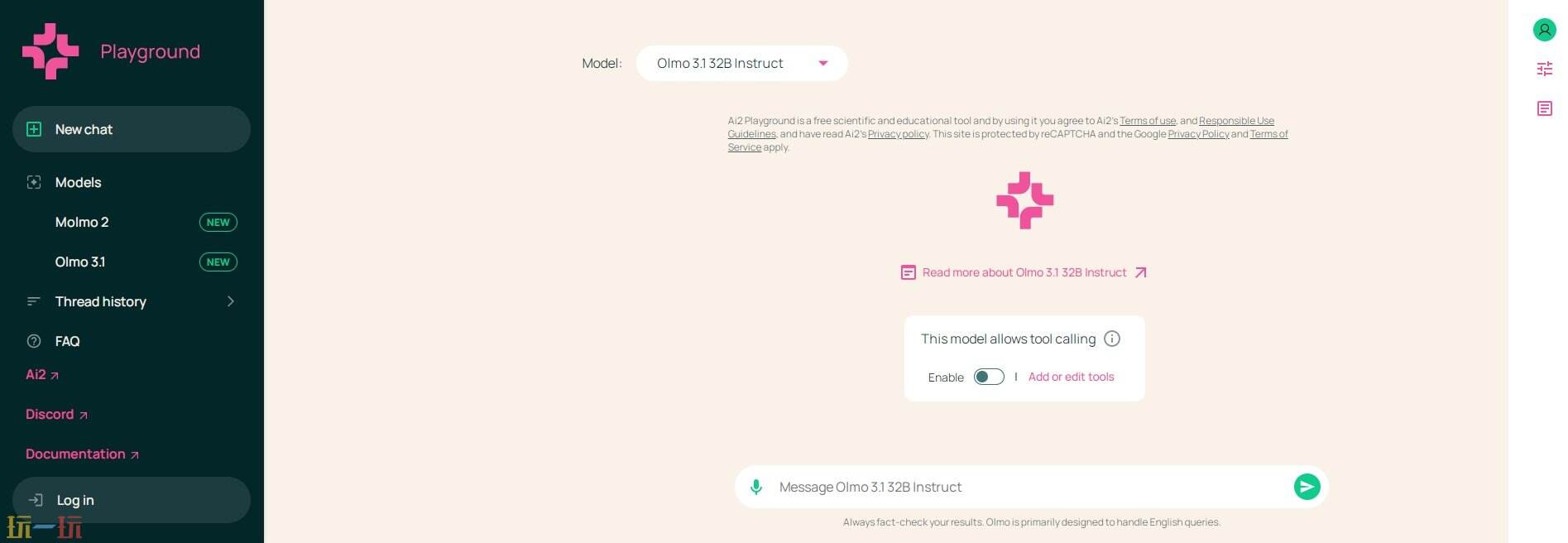

Ai2 OLMoE首页:https://playground.allenai.org/

一、官网首页网址入口

点击以下链接即可进入官方正版AI网页入口。

官网入口:https://playground.allenai.org/

二、官网介绍

官网,是由产品所属的企业、品牌或官方主体自主搭建、独立运营,以单一产品 / 产品线为核心,面向用户、市场及公众开放的唯一权威互联网官方门户,是该产品对外发布信息、提供官方服务、展示品牌价值、完成用户交互的法定正统线上平台。

三、产品应用

1. 高效研究部署:低成本复现、训练与微调MoE架构,平衡性能与算力

2. 学术研究实验:全透明训练流程,用于模型可解释性、效率优化研究

3. 边缘/本地部署:低算力设备运行接近7B级性能

4. 企业级应用:构建私有、可控、低成本的对话/内容/代码生成服务

5. 教育与教学:用于MoE架构、大模型训练原理的教学与实验

本站发布此文仅为传递信息,不代表本站认同此观点或证实其描述

相关阅读

- 英雄联盟银焰骑士(2026)系列皮肤现已上线!炫彩及完全体礼包限时上架

- 英雄联盟云顶之弈光明哨兵不朽薇恩正式上线!

- 《Jaleco Arcade Collection Vol. 1&2》将登陆PC平台

- 《香格里拉·开拓异境》手游将于2026年在日服发售

- 动漫风3D冒险《ARIE:月咏》5月13日发售!试玩已上线

- 快节奏动作《三丽鸥乱斗嘉年华》3月26日发售

- 最终幻想手游《最终幻想 纷争 DUELLUM》3月24日上线

- Switch2 Game Cube新增游戏《宝可梦XD暗之旋风黑暗洛奇亚》

- 肉鸽动作平台游戏《SlashZero》预告发布

- 《修道院:红衣修女遗迹》预告发布!预计于2026年推出

- 《星空》PS5版本4月7日发售!DLC地球舰队同步推出

- 温馨房间布置游戏《回忆房间》将于2026年Q2推出

- 《死亡搁浅2:冥滩之上》PC版将于3月19日发售

- 快节奏俯视角动作《九山:狼之城》试玩版现已上线

- 《德米欧x龙与地下城:战痕》“Warlock”更新现已发布!新增邪术师